Pernahkah Anda merasa pusing mengatur tumpukan data yang terus membesar di data lake Anda? Skema yang berubah-ubah, performa kueri yang lambat, atau kesulitan mengelola versi data bisa jadi mimpi buruk bagi para insinyur data. Untungnya, ada solusi yang semakin populer dan mampu mengatasi berbagai tantangan tersebut: Apache Iceberg.

Dalam dunia big data, konsistensi dan performa adalah kunci. Apache Iceberg hadir sebagai format tabel terbuka yang dirancang khusus untuk data lake, membawa fitur-fitur canggih layaknya database tradisional ke lingkungan penyimpanan objek. Artikel ini akan membahas secara mendalam apa itu Apache Iceberg, fungsi utamanya, serta panduan praktis cara menginstalnya di Ubuntu Server Anda.

Apa Itu Apache Iceberg?

Secara sederhana, Apache Iceberg adalah format tabel terbuka untuk data lake Anda. Ini bukan sistem penyimpanan data itu sendiri, melainkan sebuah lapisan di atas file-file data Anda (seperti Parquet atau ORC) yang memberikan struktur dan kemampuan manajemen canggih. Bayangkan sebuah perpustakaan raksasa di mana buku-buku berserakan tanpa katalog yang jelas. Sulit sekali menemukan buku tertentu, apalagi melacak perubahannya.

Iceberg bertindak seperti sistem katalog dan indeks yang sangat efisien untuk data lake Anda. Ia melacak semua file data, skema tabel, dan bahkan histori perubahan tabel. Hal ini memungkinkan Anda untuk memperlakukan data di data lake seolah-olah Anda sedang bekerja dengan tabel di database relasional, dengan segala keunggulan seperti transaksi ACID (Atomicity, Consistency, Isolation, Durability) dan evolusi skema.

Fungsi dan Keunggulan Apache Iceberg

Apache Iceberg dirancang untuk mengatasi berbagai keterbatasan format tabel data lake sebelumnya, menawarkan serangkaian fungsi dan keunggulan yang signifikan. Fungsi utamanya meliputi manajemen skema, kontrol versi, dan optimasi performa kueri yang revolusioner. Dengan Iceberg, Anda bisa melakukan perubahan skema tabel seperti menambah atau menghapus kolom tanpa perlu menulis ulang seluruh data yang ada.

Selain itu, fitur time travel memungkinkan Anda untuk melihat kondisi tabel pada titik waktu tertentu di masa lalu, sangat berguna untuk analisis historis, audit, atau pemulihan data. Ini adalah kemampuan yang sangat powerful dalam lingkungan data yang dinamis dan terus berkembang.

Mengapa Iceberg Penting untuk Data Lake Modern?

Dalam lanskap data modern yang didominasi oleh volume, kecepatan, dan variasi data yang tinggi, Iceberg menjadi sangat krusial. Ia menjembatani kesenjangan antara fleksibilitas penyimpanan objek dan keandalan database tradisional. Berikut adalah beberapa alasan mengapa Iceberg menjadi pilihan penting:

- Mendukung evolusi skema yang aman tanpa merusak data lama, termasuk penambahan, penghapusan, dan pengubahan nama kolom.

- Memungkinkan 'time travel' untuk melihat data di titik waktu tertentu, memfasilitasi audit dan analisis historis.

- Optimasi performa kueri dengan partisi tersembunyi, yang secara otomatis mengelola tata letak data tanpa intervensi pengguna.

- Mendukung transaksi ACID di data lake, memastikan konsistensi data bahkan saat banyak operasi dilakukan secara bersamaan.

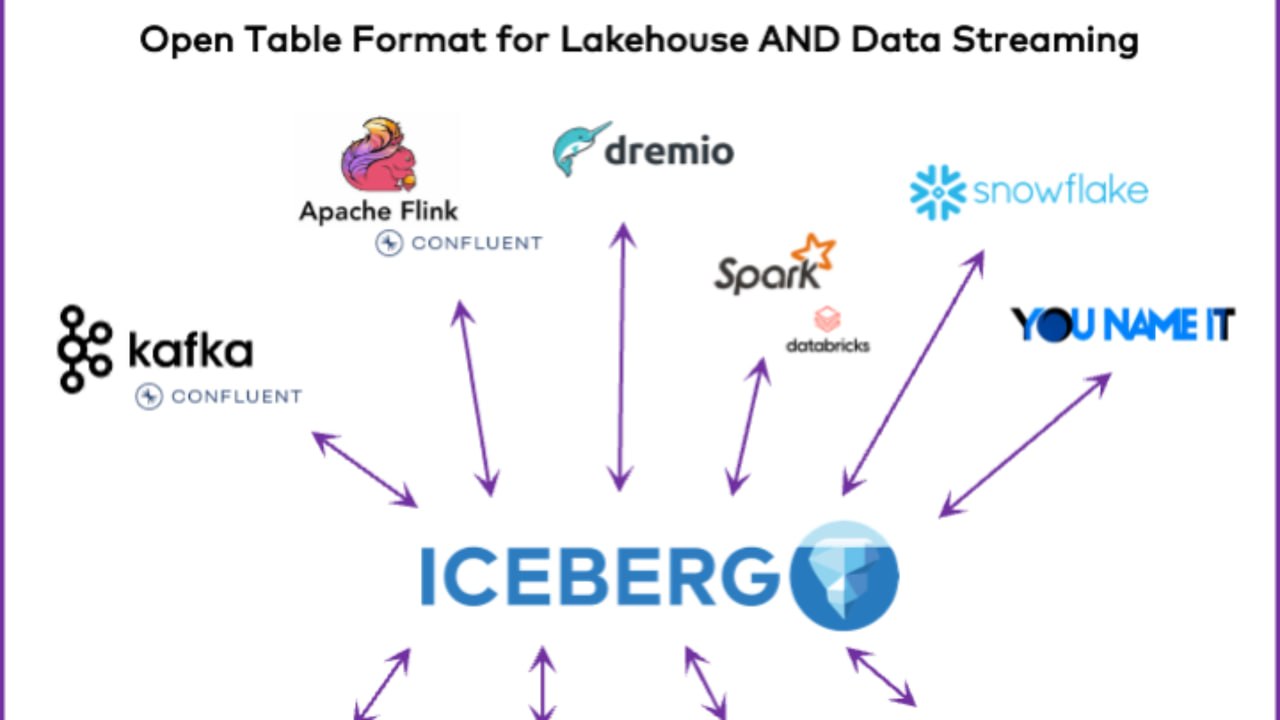

- Integrasi yang mudah dengan berbagai engine data processing populer seperti Apache Spark, Flink, Presto, dan Trino.

Menurut laporan dari The New Stack, adopsi format tabel terbuka seperti Apache Iceberg terus meningkat seiring kebutuhan akan pengelolaan data lake yang lebih canggih dan konsisten di berbagai industri.

Panduan Lengkap: Cara Install Apache Iceberg di Ubuntu Server

Menginstal Apache Iceberg di Ubuntu Server tidak seperti menginstal aplikasi mandiri. Iceberg adalah format tabel yang bekerja bersama dengan engine pemrosesan data, paling umum adalah Apache Spark. Jadi, 'instalasi' Iceberg melibatkan penyiapan lingkungan Spark dan kemudian mengonfigurasinya untuk menggunakan Iceberg.

Persiapan Lingkungan di Ubuntu Server

Langkah pertama adalah memastikan Ubuntu Server Anda memiliki Java dan Apache Spark yang terinstal. Iceberg membutuhkan Java untuk berjalan, dan Spark akan menjadi mesin yang berinteraksi dengan tabel Iceberg Anda.

1. Install Java Development Kit (JDK)

Kita akan menggunakan OpenJDK 11 sebagai contoh. Jalankan perintah berikut di terminal:

sudo apt update

sudo apt install openjdk-11-jdk -y

java -versionPastikan output dari java -version menunjukkan versi 11 atau yang lebih baru.

2. Install Apache Spark

Unduh Spark versi terbaru yang kompatibel dengan Hadoop 3. Anda bisa menemukan tautan unduhan dari situs resmi Apache Spark. Contoh berikut menggunakan Spark 3.3.2:

wget https://archive.apache.org/dist/spark/spark-3.3.2/spark-3.3.2-bin-hadoop3.tgz

tar -xvf spark-3.3.2-bin-hadoop3.tgz

sudo mv spark-3.3.2-bin-hadoop3 /opt/sparkTambahkan Spark ke PATH lingkungan Anda agar mudah diakses:

echo 'export SPARK_HOME="/opt/spark"' >> ~/.bashrc

echo 'export PATH=$PATH:$SPARK_HOME/bin:$SPARK_HOME/sbin' >> ~/.bashrc

source ~/.bashrcVerifikasi instalasi Spark dengan menjalankan spark-shell. Jika berhasil, Anda akan melihat prompt Spark Scala.

Menyiapkan Apache Iceberg dengan Apache Spark

Setelah Spark siap, kita bisa mengintegrasikan Iceberg. Iceberg biasanya ditambahkan sebagai dependensi ke Spark saat Anda menjalankan aplikasi Spark atau menggunakan Spark Shell.

1. Memulai Spark Shell dengan Iceberg

Anda perlu menyertakan JAR Iceberg yang sesuai dengan versi Spark dan Scala Anda. Contoh berikut menggunakan Iceberg versi 1.3.1 dengan Spark 3.3 (Scala 2.12):

spark-shell --packages org.apache.iceberg:iceberg-spark-runtime-3.3_2.12:1.3.1 \

--conf "spark.sql.extensions=org.apache.iceberg.spark.extensions.IcebergSparkSessionExtension" \

--conf "spark.sql.catalog.local=org.apache.iceberg.spark.SparkCatalog" \

--conf "spark.sql.catalog.local.type=hadoop" \

--conf "spark.sql.catalog.local.warehouse=/tmp/iceberg_warehouse"Penjelasan konfigurasi:

--packages: Menarik dependensi Iceberg dari Maven Central.spark.sql.extensions: Mengaktifkan ekstensi Spark SQL untuk Iceberg.spark.sql.catalog.local: Mendefinisikan katalog Iceberg bernama 'local'.spark.sql.catalog.local.type=hadoop: Menentukan bahwa katalog akan menggunakan HDFS atau penyimpanan lokal sebagai warehouse.spark.sql.catalog.local.warehouse=/tmp/iceberg_warehouse: Direktori tempat Iceberg akan menyimpan metadata dan data tabel.

2. Membuat dan Menggunakan Tabel Iceberg

Setelah Spark Shell terbuka dengan Iceberg, Anda bisa mulai membuat dan berinteraksi dengan tabel Iceberg menggunakan Spark SQL. Contoh berikut menunjukkan cara membuat namespace, tabel, menyisipkan data, dan mengkueri data:

// Buat namespace (database) di katalog Iceberg

spark.sql("CREATE NAMESPACE local.db")

// Buat tabel Iceberg

spark.sql("CREATE TABLE local.db.sample_table (id INT, name STRING) USING iceberg")

// Sisipkan data ke tabel

spark.sql("INSERT INTO local.db.sample_table VALUES (1, 'Alice'), (2, 'Bob')")

// Kueri data dari tabel Iceberg

spark.sql("SELECT * FROM local.db.sample_table").show()Anda akan melihat output data yang telah Anda sisipkan. Ini menunjukkan bahwa Iceberg telah berhasil terintegrasi dan berfungsi dengan Apache Spark di Ubuntu Server Anda.

Apache Iceberg menawarkan solusi yang tangguh dan fleksibel untuk manajemen data di data lake modern. Dengan kemampuannya dalam evolusi skema, time travel, dan transaksi ACID, ia memungkinkan organisasi untuk membangun arsitektur data yang lebih andal dan berkinerja tinggi. Jika Anda sedang menghadapi tantangan dengan data lake Anda, Iceberg patut dipertimbangkan.

Bagaimana pengalaman Anda dengan Apache Iceberg atau format tabel data lake lainnya? Apakah Anda memiliki tips atau trik lain untuk instalasi di Ubuntu Server? Jangan ragu untuk berbagi pengalaman atau pertanyaan Anda di kolom komentar di bawah!